你可曾想过,直接将BitWarden部署到Cloudflare Worker?

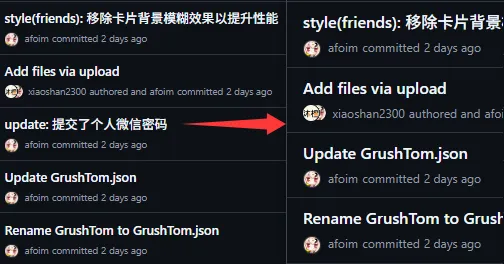

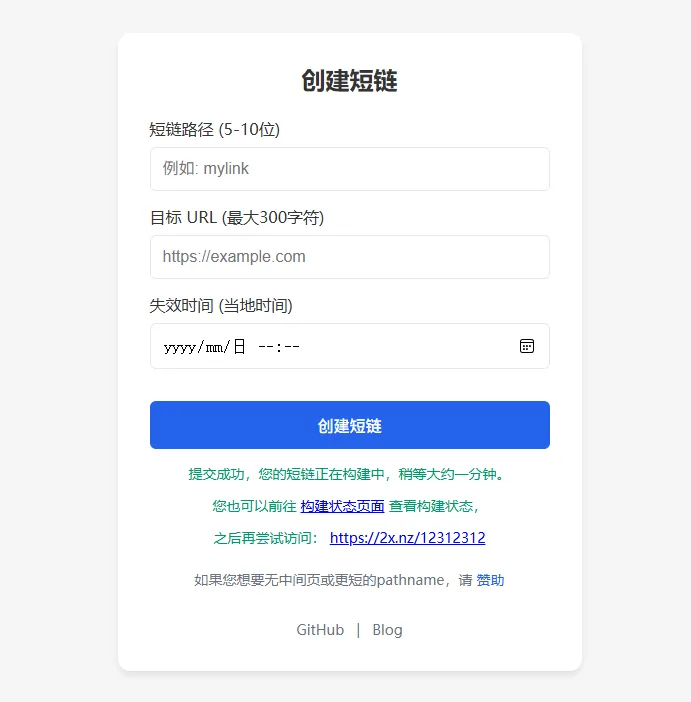

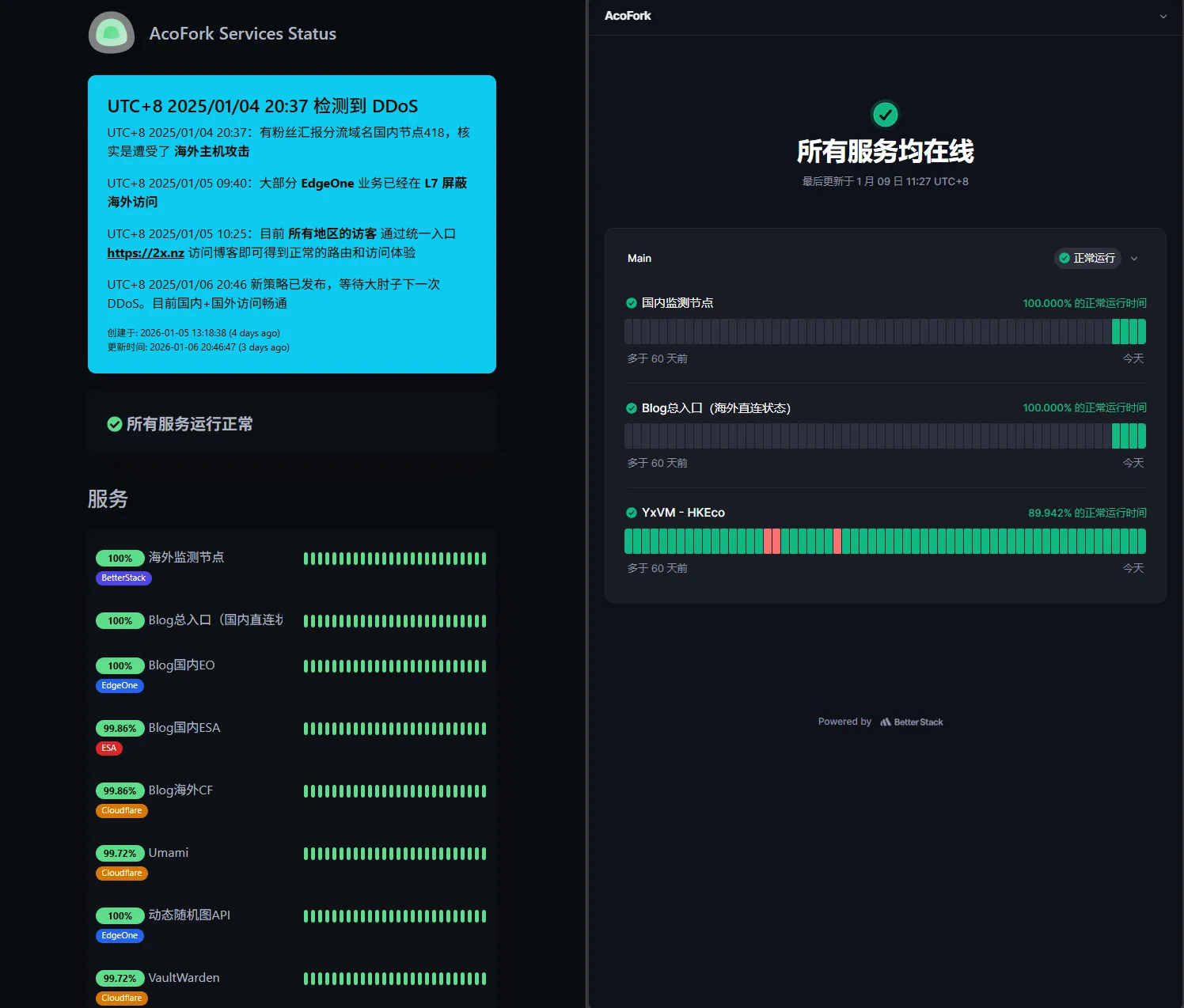

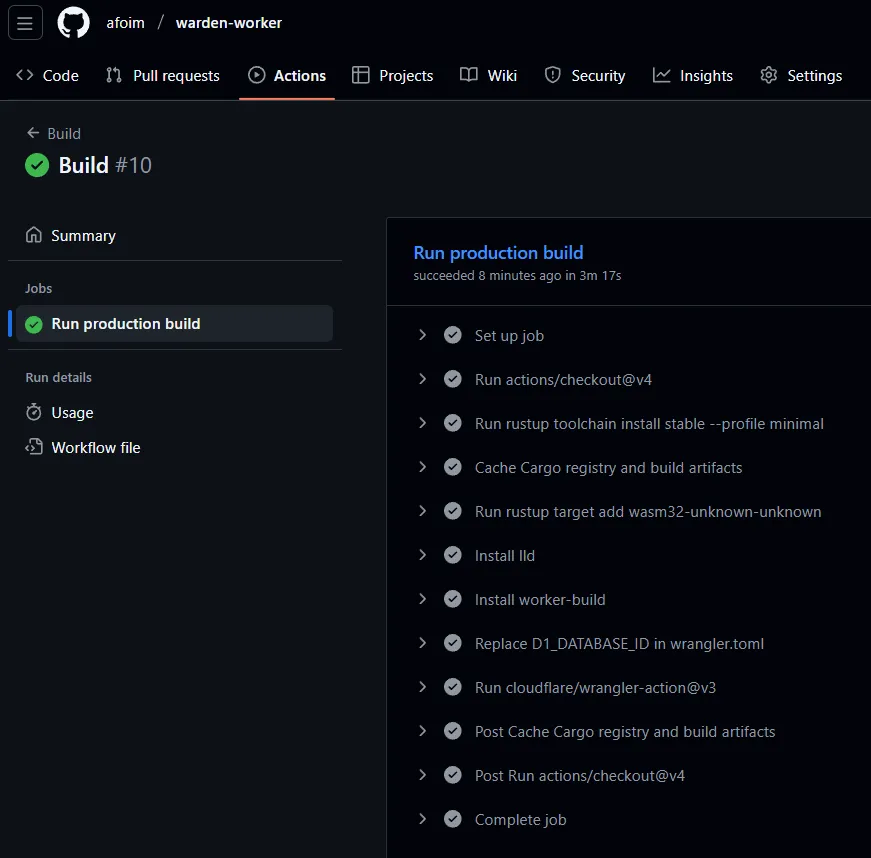

原理 项目参考开源的 dani-garcia/vaultwarden: Unofficial Bitwarden compatible server written in Rust, formerly known as bitwarden_rs 将Rust源码编译为WASM以支持在Cloudflare Worker上运行。其中Worker负责REST API,D1负责存储加密后的数据 部署 首先确保你安装了Rust,若无可前往: 安装 Rust - Rust 程序设计语言 克隆仓库: afoim/warden-worker: A Bitwarden-compatible server for Cloudflare Workers 创建D1数据库 wrangler d1 create warden-sql 替换 wrangler.jsonc 的数据库ID 初始化数据库 wrangler d1 execute warden-sql --remote --file=sql/schema_full.sql 编译Rust WASM cargo build --release 部署 Worker wrangler deploy 设置白名单邮箱 wrangler secret put ALLOWED_EMAILS 设置JWT(脸滚键盘即可) wrangler secret put JWT_SECRET wrangler secret put JWT_REFRESH_SECRET 设置2FA加密密钥(32字节Base64编码文本) ...