魔幻嫁接!免费用上完全体的Bitwarden!

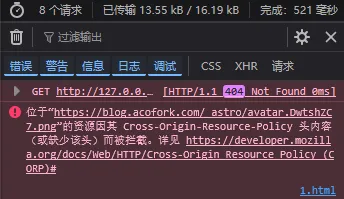

Bitwarden以及Bitwarden.com是什么 Bitwarden是一个开源的密码库工具(云服务或自托管),用户可以将所有网站的登录凭据(包含:密码、TOTP、通行密钥等) 端到端加密 存储至其中。并在需要的时候自动填充帮你登录网站。这样,你就不再需要记住各个网站的账号密码了,只要你能访问Bitwarden,它会帮你做好一切 而Bitwarden.com是一项服务,提供用以存储密码库的服务器,使得用户 无需自有服务器 就可以使用Bitwarden Bitwarden.com 免费版的“默认”限制 Best Password Manager for Business, Enterprise & Personal | Bitwarden 免费版没法用TOTP,必须花钱来升级套餐实现 我们当然也可以选择不在任何网站使用TOTP,但这样的话。所有网站都只有密码保护你的账号,从长远来看这并不安全 Bitwarden.com 免费版实际上限制的东西 实际上,如果你曾经用过其他密码库,并存储了TOTP,并将其导入到 Bitwarden.com ,你会发现,它是可以成功导入的,只不过是无法“自动填充” 那么也就是说,实际上 Bitwarden.com 并没有封禁免费用户存储TOTP的权限 它只是在前端阻止了免费用户“自动填充”TOTP的权限 绕过 Bitwarden.com 免费版无法自动填充TOTP的限制 既然它是在前端阻止,我们实际上是有办法绕过的 无非就是自建一个第三方客户端/浏览器插件,然后在判断VIP的字段让它始终返回 true 即可 我们当然可以自己从零来实现,当然,也可以直接寻找市面上已有的,不错的解决方案 针对于 Android 我们可以使用 AChep/keyguard-app: Alternative client for the Bitwarden® platform & KeePass (KDBX), created to provide the best user experience possible. 这个开源的第三方Bitwarden客户端 注意,不要去Google Play下载。只有Github的版本拥有全部功能 此时,登录你的Bitwarden账号,即可绕过免费版限制,使用TOTP自动填充 关于KeyGuard对通行密钥的适配问题 KeyGuard可能无法自动填充你的通行密钥,这可能由多种情况导致,但一般是这种情况: [虫子]通行密钥在Cloudflare上无法使用·第#635期 ·AChep/keyguard-app 可以尝试重新生成一份通行密钥,通过KeyGuard上传至Bitwarden.com 但更建议: 不使用通行密钥,而是使用更广泛的TOTP二步验证方式 ...